在AI的浩瀚星空中,一颗未及正式升起便已璀璨夺目的新星悄然划破天际,引起了整个科技界的轩然大波。Llama 3.1,这座拥有4050亿参数的开源巨兽,其未发先泄的壮举,在Reddit上掀起了前所未有的讨论热潮。这不仅是对现有AI技术边界的一次勇敢探索,更是开源精神在AI领域的一次壮丽绽放。

想象一下,一个由Meta(原Facebook)倾力打造,却意外提前泄露的大型语言模型,其规模之庞大,性能之强劲,足以让业界为之侧目。Llama 3.1,这个名字或许还鲜为人知,但它所蕴含的潜力与实力,已足以让每一个关注AI发展的人心跳加速。4050亿参数的庞大规模,让它在众多开源模型中独树一帜,更有人将其视为最接近甚至在某些方面超越GPT-4o的存在。这一泄露事件不仅是对AI技术创新能力的一次检验,更是对开源文化力量的深刻诠释。

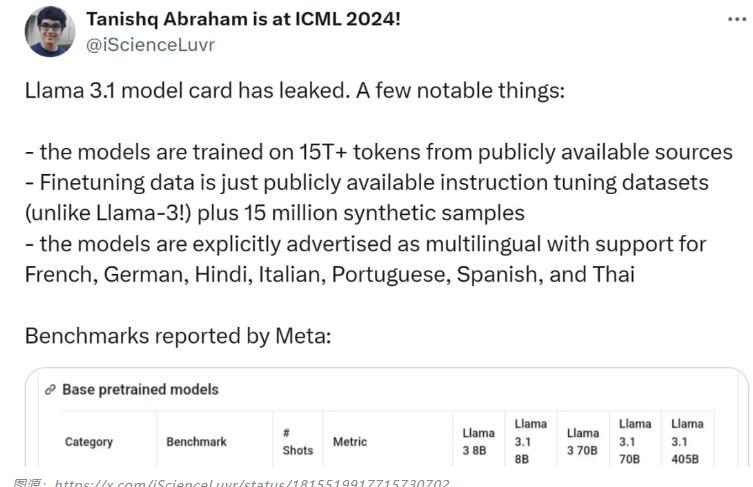

从泄露的基准测试结果来看,Llama 3.1的表现无疑令人瞩目。即便是70B版本的Llama 3.1,在多项关键测试中也能与GPT-4o一较高下,甚至在某些方面实现了超越。这不仅是开源模型历史上的一个里程碑,更是对人工智能技术边界的一次勇敢突破。这样的成绩背后,是Meta团队无数日夜的辛勤耕耘,也是全球AI研究者共同努力的结果。开源的力量在于共享与协作,Llama 3.1的出现,无疑将激励更多研究者投身于AI技术的探索与创新之中。

除了强大的性能表现外,Llama 3.1在多语言支持方面的努力同样值得称赞。它使用了超过15万亿个tokens的公开数据进行训练,涵盖了英语、法语、德语、印地语、意大利语、葡萄牙语、西班牙语和泰语等多种语言。这意味着Llama 3.1不仅能在英语环境下游刃有余地应对各种对话任务,还能在更广泛的语言环境中展现出其独特的优势。这一特性将极大地拓宽Llama 3.1的应用场景和市场潜力,为全球用户带来更加便捷、高效的AI体验。

在追求高性能与多语言支持的同时,Llama 3.1的研究团队也深知安全性的重要性。他们采取了多种措施来确保模型的安全性与可靠性。通过结合人工生成数据与合成数据的方法收集训练数据,以及引入边界prompt和对抗性prompt等技术手段,Llama 3.1在数据质量控制和模型稳定性方面表现出色。AI旋风认为,这样的安全设计不仅是对用户隐私和数据安全的负责态度体现,更是对AI技术可持续发展的重要保障。

Llama 3.1的泄露事件虽然充满了意外与波折,但它所展现出的开源精神与技术创新力量却让人倍感振奋。AI旋风相信,随着更多类似Llama 3.1这样的开源模型不断涌现,AI技术将以前所未有的速度向前发展。我们期待着这些开源模型能够为我们带来更多惊喜与改变,同时也希望业界能够共同维护一个健康、开放、合作的AI生态环境,共同推动AI技术的繁荣与进步。