在科技界的浩瀚星空中,苹果公司再次以其独特的创新光芒照亮了前行的道路。近日,苹果在开源AI的殿堂——Hugging Face平台上,悄然投下了一颗震撼业界的“炸弹”,正式开放了其去年备受瞩目的4M模型演示。这一举动不仅标志着苹果在AI多模态领域的深度探索取得了突破性进展,更预示着其正以前所未有的姿态,拥抱开源生态,携手全球开发者共创未来。

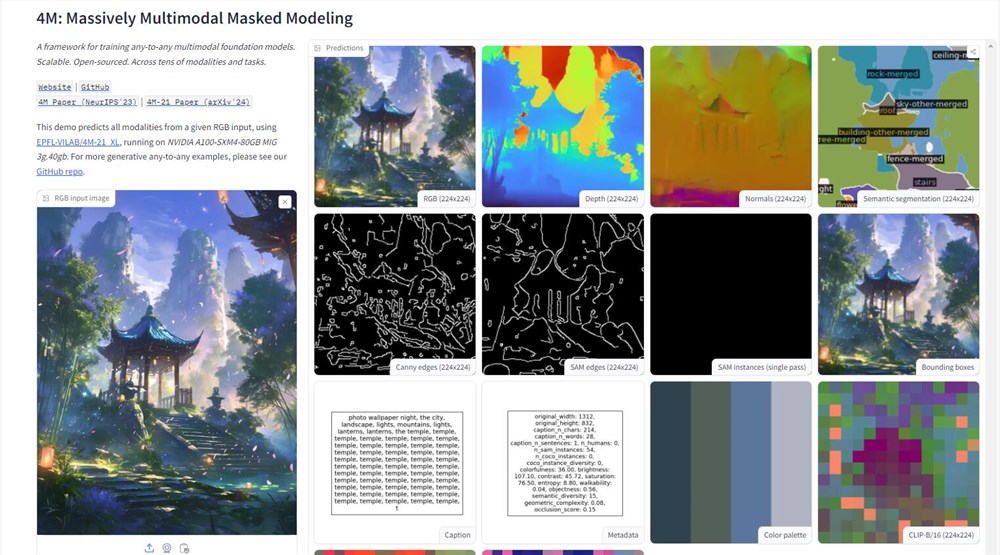

4M模型,如其名所寓意的“Multi-Modal”(多模态)之精髓,凭借其强大的处理与生成能力,轻松将图片中的每一个细节、每一层信息抽丝剥茧般呈现出来。从细腻的深度图到简洁的线稿,再到图片的主要轮廓、色调分布乃至精确尺寸,只需轻轻一点,上传的图片便能在4M的“火眼金睛”下无所遁形。AIbase率先以一幅古风意境图片进行了测试,结果令人叹为观止,仿佛为这幅画作绘制了一幅详尽的信息地图。

苹果此举,无疑是其在研发保密传统上的一次大胆转身。长久以来,苹果以其封闭而高效的生态系统著称,而此次在Hugging Face平台上开放4M模型演示,不仅是对自身AI实力的自信展示,更是向全球开发者发出的诚挚邀请。苹果希望通过这种方式,构建一个围绕4M模型的强大生态系统,让创新的火花在开源的土壤中自由碰撞,绽放出更加璀璨的光芒。

4M模型的多模态架构,为苹果生态的未来发展铺设了宽广的道路。随着4M技术的不断成熟与应用,我们可以预见Siri将变得更加智能,能够更精准地理解复杂指令,甚至参与到日常生活的方方面面;而Final Cut Pro等创意工具,也将因4M的加入而变得更加高效,用户只需简单的语言描述,即可实现视频素材的自动剪辑与编辑。这一切,都将极大地提升用户体验,推动苹果生态向更加智能、便捷的方向发展。

然而,4M模型的问世,也伴随着数据实践与AI伦理的双重挑战。苹果作为用户隐私的坚定守护者,如何在推动AI技术进步的同时,确保用户数据的安全与隐私不受侵犯,成为了一个亟待解决的问题。AI旋风认为,苹果需要在这两者之间找到微妙的平衡点,通过技术手段与法律框架的双重保障,让用户在享受AI带来的便利时,也能感受到满满的安全感与信任感。

深入剖析4M模型的技术原理,其“大规模多模态屏蔽建模”训练方法无疑是其中的核心亮点。这种方法能够巧妙地将图像、语义、几何等多种视觉模态转化为统一的tokens,实现模态间的无缝对接与高效处理。在训练过程中,4M通过随机选择部分标记作为输入,另一部分作为目标的方式,极大地提升了模型的通用性与可扩展性。

值得一提的是,4M模型所依赖的训练数据集——CC12M,虽然数据丰富但标注信息不全。面对这一挑战,研究团队采用了弱监督伪标签的方法,结合CLIP、MaskRCNN等先进技术,对数据集进行全面预测与标注,为4M的多模态兼容奠定了坚实的基础。

随着苹果4M模型演示的开放,一个全新的AI时代正在向我们走来。在这个时代里,图片将不再仅仅是视觉的载体,更是信息的宝库;AI将不再局限于单一领域的应用,而是跨越模态、融合创新。AI旋风相信,在苹果与全球开发者的共同努力下,4M模型必将引领我们迈向一个更加智能、多彩的未来。