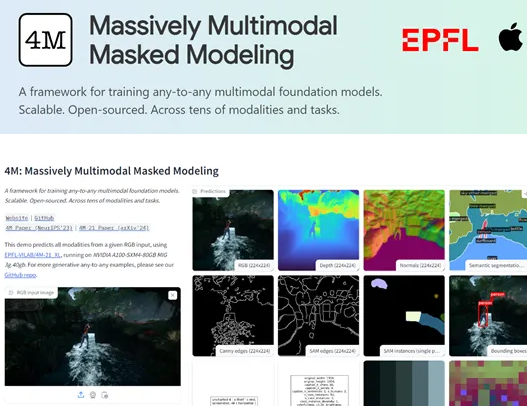

在人工智能的浩瀚星空中,又一颗璀璨的明星正冉冉升起。科技巨头苹果与学术殿堂瑞士洛桑联邦理工学院强强联手,共同开源了一款革命性的多模态视觉模型——4M-21。这款模型以其卓越的通用性、灵活性及强大的多模态处理能力,正引领着AI视觉技术迈向新的高度。

不同于以往专注于单一任务或数据类型的AI模型,4M-21以其独特的魅力脱颖而出。AI旋风认为,这款模型之所以引人注目,首先在于其广泛的通用性和灵活性。在仅有30亿参数的情况下,4M-21却能轻松驾驭图像分类、目标检测、语义分割、实例分割、深度估计、表面法线估计等数十种视觉任务,展现出惊人的“多才多艺”。这一特性无疑为开发者们提供了前所未有的便利,使得他们能够在不同应用场景下快速部署和优化AI解决方案。

那么,是什么赋予了4M-21如此强大的能力呢?答案在于其核心技术——“离散Tokens”转换技术。据了解,这项技术如同一座桥梁,将图像、神经网络特征图、向量、结构化数据乃至文本等不同模态的数据,无缝转化为模型能够理解的统一格式Tokens序列。这种转换的魔力不仅简化了模型的训练过程,更为多模态学习和处理铺设了坚实的基石。通过这一转换,4M-21能够轻松跨越不同模态之间的鸿沟,实现信息的无缝融合与交互。

在训练阶段,4M-21采用了创新的掩码建模方法,进一步提升了其多模态学习的能力。该方法通过随机遮盖输入序列中的部分Tokens,迫使模型基于剩余未遮盖的信息来预测被遮盖的部分。这一过程不仅考验着模型对输入数据统计结构和潜在关系的捕捉能力,更促进了模型对多模态间信息共通性和交互性的深刻理解。掩码建模的引入,不仅显著增强了4M-21的泛化能力,还使得其在生成任务中的准确性得到了显著提升。

为了验证4M-21的实力,研究人员在多个视觉任务上进行了全面而深入的评测。从图像分类到目标检测,从语义分割到实例分割,再到深度估计、表面法线估计以及3D人体姿态估计等复杂任务,4M-21均展现出了令人瞩目的表现。AI旋风认为,这些评测结果充分证明了4M-21在多模态处理能力上的卓越性,其性能已可与当前最先进的模型相媲美,甚至在某些方面实现了超越。

综上所述,苹果与瑞士洛桑联邦理工学院联合开源的4M-21多模态视觉模型,无疑是AI领域的一次重大突破。它不仅为开发者们提供了强大的工具,更为多模态学习和处理开辟了新的道路。随着4M-21的广泛应用和持续优化,我们有理由相信,AI视觉技术将迎来更加辉煌的未来。