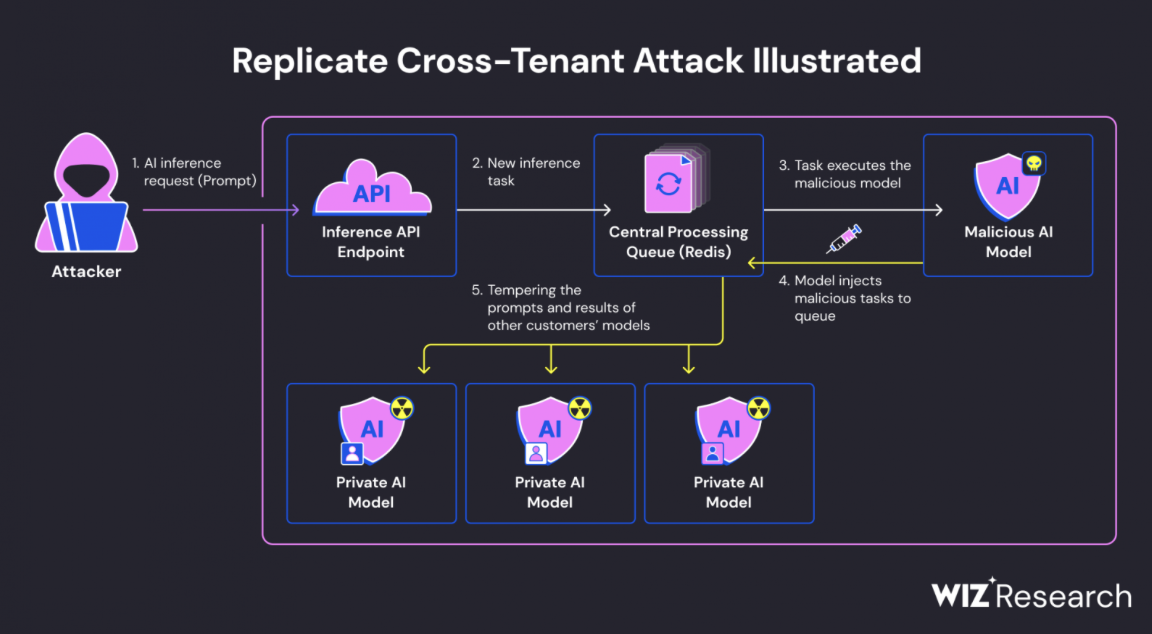

近日,安全公司Wiz发布了一份引人关注的报告,揭示了开源AI模型共享平台Replicate存在一项重大安全漏洞。据称,黑客可利用这一漏洞实施“跨租户攻击”,即利用多租户环境中的安全缺陷访问或干扰其他租户的数据资源,从而可能导致平台用户训练的AI模型内部机密数据泄露。

据了解,Replicate平台为了提高AI模型推论(inference)效率,推出了模型容器化格式Cog。这一创新格式在显著提升模型与效率的同时,却忽略了其中的安全隔离机制,为黑客提供了可乘之机。

据Wiz公司的安全研究员分析,黑客可将精心训练的恶意模型封装成Cog容器,并通过Replicate的用户操作界面与容器进行互动。他们成功地进行了一系列远程执行代码(RCE)攻击测试,并轻易获得了容器的root权限。这意味着黑客已经取得了在平台内部深度操作的能力。

进一步地,研究人员深入调查了Replicate平台的基础设施,利用当前容器的TCP连接成功访问到另一台容器。他们利用名为rshijack的工具,将特定数据注入至TCP连接中,成功绕过了平台的身份验证步骤,进一步侵入了其他用户的AI模型。

AI旋风认为,这一漏洞的严重性不容忽视。黑客利用此漏洞不仅能轻易获取其他用户自用的AI模型,还能自由地从模型问答记录中提取用户隐私数据,甚至自由下载或修改用户模型内容。这不仅对平台本身构成了严重威胁,也对用户的数据安全和隐私保护构成了极大挑战。

值得庆幸的是,Replicate平台在接到Wiz的通报后,迅速采取了修复措施,及时弥补了这一安全漏洞。平台方面表示,目前没有检测到有用户AI模型外流的迹象,这在一定程度上减轻了用户的担忧。

然而,此次事件再次提醒我们,随着人工智能技术的快速发展和广泛应用,AI平台的安全问题也日益凸显。AI旋风呼吁,各AI平台应高度重视安全问题,加强技术研发和安全管理,确保用户数据的安全和隐私保护。同时,用户在使用AI平台时也应提高警惕,加强自我防护意识,避免个人信息的泄露和滥用。