在数字化时代,人工智能(AI)语言模型平台以其卓越的性能和广泛的应用场景,已成为企业和个人处理自然语言任务的重要工具。然而,近期安全公司Sysdig发布的一份报告揭示了一个令人不安的现象:黑客正在瞄准各大AI语言模型平台,发动名为“LLM劫持(LLMjacking)”的攻击,意图窃取用户账号密码、转卖API余额以及获取隐私信息。

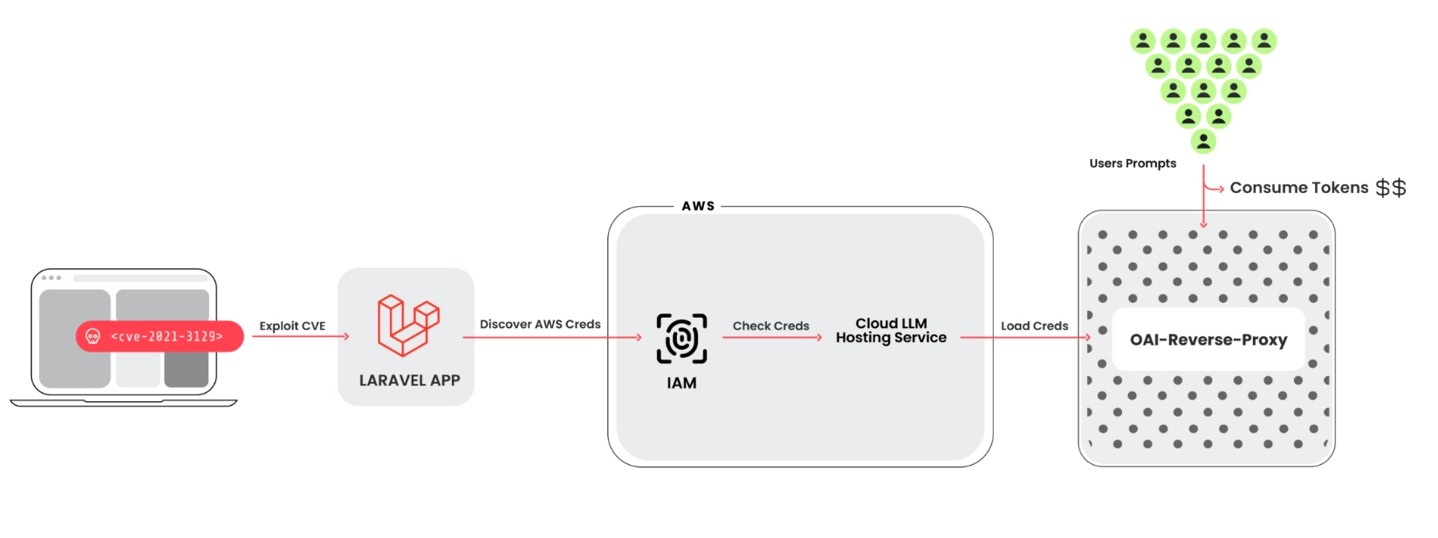

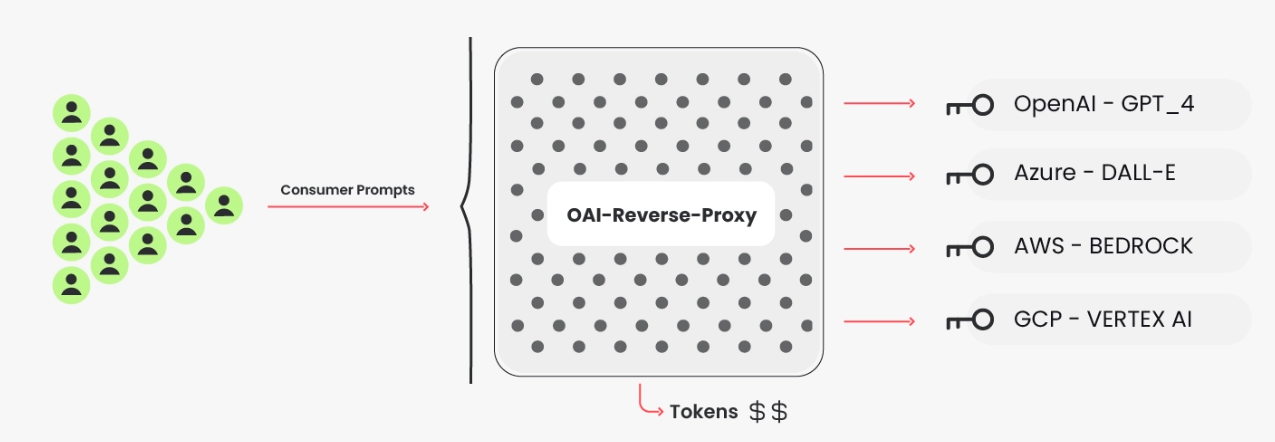

据了解,Sysdig在报告中详细描述了黑客的攻击手法。他们通过一系列技术手段,如撞库攻击和利用PHP框架Laravel的凭据漏洞(CVE-2021-3129),成功盗取了用户账号的密码。一旦得手,黑客便能控制用户的账号,进而将模型API的使用权转卖给第三方,甚至从用户的对话记录中筛选出隐私信息,用于勒索或公开贩售。

值得注意的是,Sysdig在报告中特别指出了Anthropic的Claude v2 / v3平台成为黑客的“偏好”目标。这一发现不禁让人对AI语言模型平台的安全性产生质疑。据Sysdig统计,目前已有不少企业用户成为了黑客的受害者。这些用户在不知情的情况下,每天需要为黑客支付的API使用费高达4.6万美元(当前约33.3万元人民币),给企业带来了巨大的经济损失。

黑客之所以瞄准AI语言模型平台,主要是因为这些平台拥有巨大的商业价值。随着AI技术的不断发展,越来越多的企业和个人开始使用AI语言模型来处理自然语言任务。然而,由于安全意识的不足和技术防范的缺失,这些平台往往成为黑客攻击的重点目标。

除了Anthropic的Claude平台外,此前也有安全公司发现Hugging Face平台存在API凭据漏洞。这一漏洞允许黑客获取微软、谷歌、Meta等知名公司的令牌,进而控制这些公司的模型库。幸运的是,Hugging Face已经及时修复了相关漏洞,避免了潜在的安全风险。

面对这一严峻的安全形势,各大AI语言模型平台必须加强安全防范措施。首先,平台方应加强对用户账号和密码的保护,采取更加复杂和安全的加密算法,防止黑客通过撞库等手段窃取用户信息。其次,平台方应加强对API接口的监控和管理,及时发现并阻止异常访问行为。此外,平台方还应加强与合作伙伴的沟通和协作,共同应对黑客攻击带来的安全威胁。

对于企业和个人用户而言,AI旋风也提醒大家要增强安全意识,保护好自己的账号和密码。建议使用强密码、定期更换密码、开启双重验证等安全措施,确保账号安全。同时,用户在使用AI语言模型平台时,也应注意保护个人隐私信息,避免在对话中泄露敏感信息。

AI旋风相信,在平台方和用户的共同努力下,我们一定能够抵御黑客的攻击,保障AI语言模型平台的安全稳定运行。同时,我们也期待各大平台能够不断完善自身的安全体系,为用户提供更加安全、可靠的服务。