在数字化创意内容领域,南开大学HVision团队近日推出了一款名为StoryDiffusion的神奇工具,这款工具能够保持角色的一致性,并生成多图漫画和长视频,为创作者们带来了前所未有的创作便利和可能性。

StoryDiffusion通过实现Consistent self-attention和Motion predictor两项关键技术,成功实现了连贯图像和视频的生成。这一技术的核心在于,它能够根据用户提供的文本提示,生成角色连贯的图像序列,并预测不同条件图像之间的运动,从而实现更大幅度的运动预测。

“StoryDiffusion的推出,无疑是数字化创意内容领域的一大突破。”AI旋风认为,这款工具通过深度学习算法,实现了图像和视频的自动化生成,不仅大大提高了创作效率,还保证了作品的连贯性和一致性。

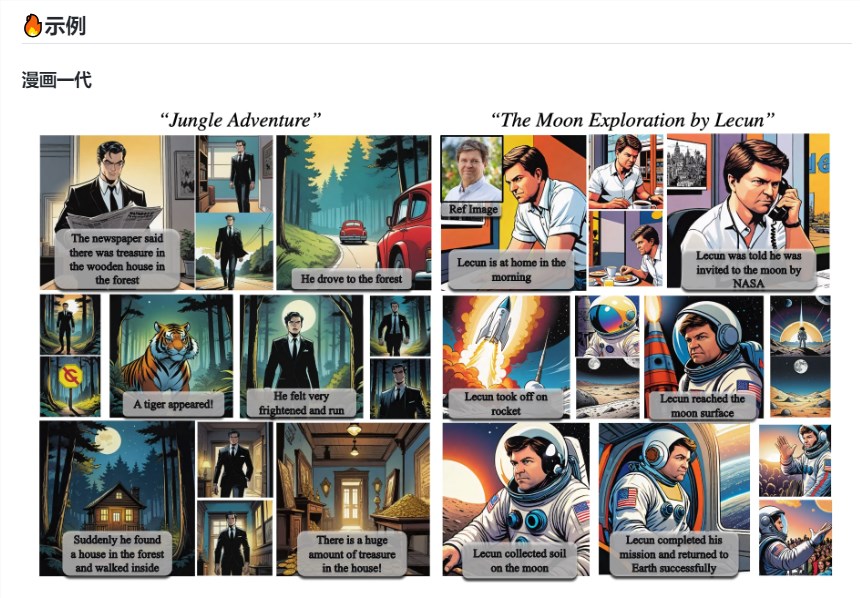

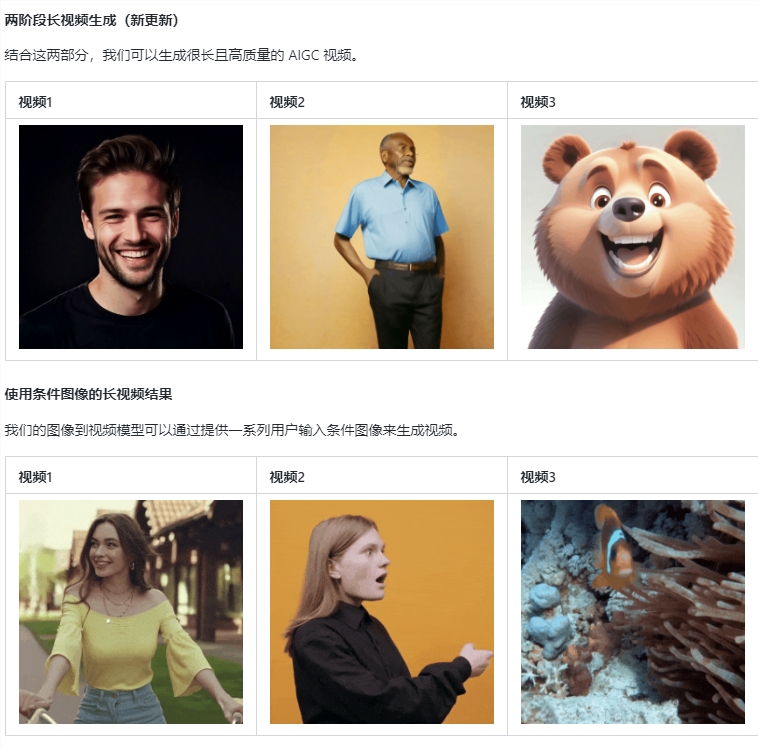

在应用方面,StoryDiffusion的潜力可谓无穷无尽。首先,它可应用于漫画生成领域。通过Consistent self-attention机制生成的图像,可以顺利过渡为视频,实现两阶段长视频生成方法。这意味着,创作者们可以轻松地利用StoryDiffusion,将他们的漫画作品转化为动态视频,为观众带来更加生动、有趣的视觉体验。

此外,StoryDiffusion还可以应用于图像转视频等多种场景。用户可以通过提供一系列用户输入的条件图像,利用Image-to-Video模型生成视频。这一功能不仅可以帮助创作者们快速生成高质量的视频素材,还可以为广告、电影等领域提供新的创意方式和制作手段。

值得一提的是,StoryDiffusion还支持用户通过Jupyter notebook或本地adio demo来生成漫画。这为创作者们提供了更加灵活、便捷的操作方式,使得他们可以根据自己的需求和创意,随时随地进行创作。目前,该项目已经发布了生成漫画部分的源码,进一步降低了技术门槛,让更多人能够享受到数字化创意内容创作的乐趣。

除了技术上的创新之外,StoryDiffusion还体现了南开大学HVision团队对于数字化创意内容领域的深刻理解和敏锐洞察。他们认为,随着数字化技术的不断发展,人们对于创意内容的需求也在不断变化和升级。因此,他们需要不断探索新的技术、新的方法,来满足人们对于创意内容的多元化需求。

StoryDiffusion的推出不仅为创作者们提供了更加便捷、高效的创作工具,更为整个数字化创意内容领域注入了新的活力和创新力。随着AI技术的不断发展和完善,我们有理由相信,StoryDiffusion将会在更多领域得到广泛应用和推广,为人们带来更多惊喜和乐趣。