在人工智能的浪潮中,零一万物(01-AI)以其卓越的创新能力再次崭露头角。近日,该公司发布了模型家族的新成员——Yi-1.5(6B、9B、34B),并宣布这些模型全部采用Apache2.0许可开源,为全球开发者提供了一扇通往智能未来的新窗口。

Yi-1.5不仅是Yi模型的升级版,更是一次质的飞跃。它在编码、数学、推理和指令遵循能力方面实现了显著的提升,同时保持了在语言理解、常识推理和阅读理解方面的卓越能力。这一突破性的进展,预示着人工智能将在更多领域展现出其强大的应用潜力。

零一万物此次发布的Yi-1.5模型家族,涵盖了6B、9B和34B三种不同规模的模型,以满足不同应用场景的需求。其中,基础版模型在500B tokens上进行了持续预训练,而chat版则在300万个样本上进行了微调,以确保其在对话生成任务中的出色表现。

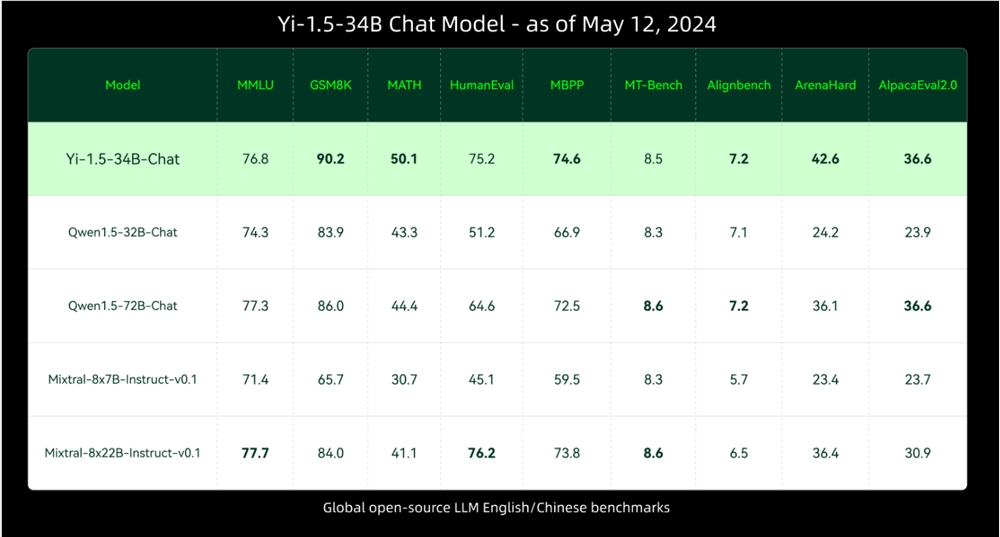

在性能方面,Yi-1.5模型家族的表现堪称惊艳。特别是34B模型,在基准测试中几乎与Meta的Llama3 70B模型相匹敌,整体效果更是超越了Qwen1.5-72B。这一成绩充分证明了Yi-1.5在处理复杂任务时的强大能力。

在具体测试中,Yi-1.5 34B模型在MMLU、HumanEval和AGIEval等基准测试中均取得了优异成绩。其中,MMLU测试得分高达77.1,HumanEval测试得分达到46.3,AGIEval测试得分也达到了71.1。这些高分不仅证明了Yi-1.5在多个领域内的卓越性能,也为其赢得了业界的广泛赞誉。

值得一提的是,Yi-1.5 9B模型在类似大小的开源模型中表现尤为突出。它与Mixtral 8x7B模型相匹配,充分展示了其在中等规模模型中的领先地位。这一成绩不仅证明了零一万物在模型优化方面的深厚实力,也为广大开发者提供了更多选择。

除了强大的性能外,Yi-1.5模型家族还具备开源可访问性。所有模型均根据Apache2.0许可发布,并在Hugging Face平台上开源。这意味着开发者可以轻松地获取并使用这些模型,无需担心版权和许可问题。同时,这也为全球范围内的研究者提供了交流和合作的机会,共同推动人工智能领域的发展。

此外,Yi-1.5模型还支持长达4K个标记的上下文长度。这一特性使得模型在处理长文本时更具优势,能够更好地捕捉和理解文本中的复杂关系和深层含义。这对于处理现实世界中的复杂问题具有重要意义。

AI旋风认为,零一万物此次发布的Yi-1.5模型家族无疑将引领人工智能领域的新一轮发展。它不仅在性能上实现了显著的提升,还具备开源可访问性和长文本处理能力等优势。这将为开发者提供更多选择和可能性,推动人工智能在更多领域的应用和发展。我们期待零一万物未来能够继续创新突破,为人类带来更智能、更便捷的未来生活。