尽管在生成式AI热潮席卷全球时,苹果并未像一些竞争对手那样迅速推出自己的AI模型,但近日一系列的研究动态表明,这家科技巨头在AI领域的布局正逐步深化。继之前分享关于新语言模型的论文以及研发AI驱动机器人的消息后,苹果再次凭借一项名为Ferret-UI的多模式大语言模型(MLLM)引起了业界的广泛关注。

AI旋风了解到,MLLM与传统的大型语言模型(LLM)相比,其显著特点在于能够处理并理解包括文本、图像和音频在内的多种模式信息。Ferret-UI正是这一新型AI技术的代表,它经过训练,能够精准识别移动用户界面(UI)屏幕上的各种元素,如应用程序图标、小文本等。过去,由于这些元素的微小和复杂特性,对于MLLM来说,识别应用屏幕元素一直是一个技术难题。然而,苹果的研究人员通过为Ferret-UI增加“任意分辨率”功能,成功地解决了这一问题,使得模型能够放大并捕捉到屏幕上的每一个细节。

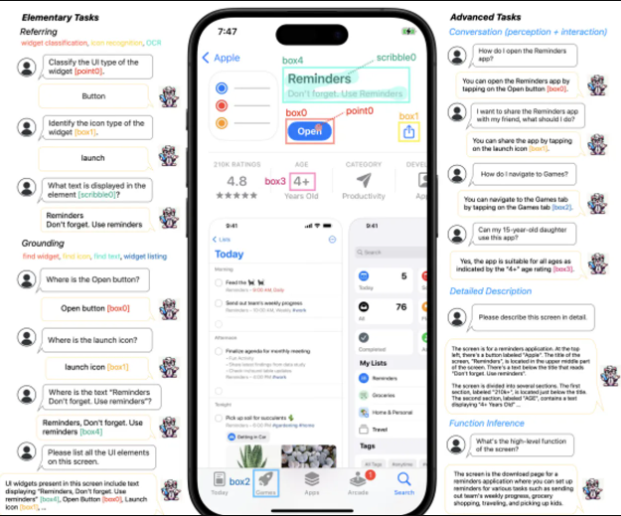

不仅如此,Ferret-UI还具备“指代、基础和推理能力”,这使其能够深入理解UI屏幕的内容,并根据这些内容执行相应的任务。这一特性预示着Ferret-UI有潜力为苹果的Siri语音助手带来革命性的提升。通过全面理解用户的应用屏幕以及执行特定任务的能力,Ferret-UI有望让Siri变得更加智能和高效,能够更好地满足用户的多样化需求。

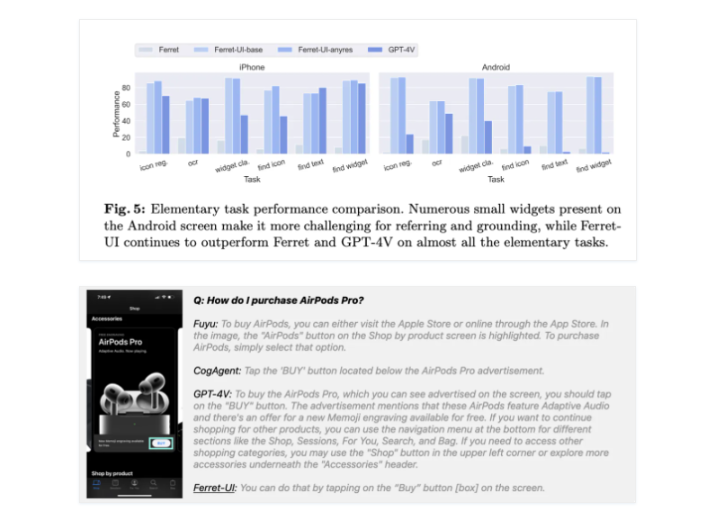

在性能方面,苹果研究人员将Ferret-UI与OpenAI的MLLM GPT-4V进行了对比测试。结果显示,在基础任务如图标识别、OCR、小部件分类等方面,无论是在iPhone还是Android平台上,Ferret-UI都展现出了卓越的性能,几乎在所有任务上均优于GPT-4V。唯一稍显逊色的是在iPhone上的“查找文本”任务中,GPT-4V略胜一筹。然而,在涉及UI调查结果的推理对话中,GPT-4V以93.4%对91.7%的微弱优势领先。尽管如此,研究人员仍强调Ferret-UI的表现“值得关注”,因为它能够生成原始的坐标信息,而不是像GPT-4V那样从预定义的框中进行选择。

关于苹果如何利用这项AI技术,论文并未给出明确的答案。然而,AI旋风认为,Ferret-UI的先进功能无疑为与UI相关的应用带来了广阔的前景。特别是对于Siri而言,这一技术的融入有望大幅提升其理解和执行用户指令的能力,使其更加贴近用户的实际需求。

展望未来,随着苹果在AI领域的持续投入和研发,我们有理由相信,更多的创新技术将不断涌现,为用户带来更加智能、便捷的体验。而Ferret-UI作为苹果AI战略的重要一环,其未来的应用和发展方向无疑值得业界和用户的持续关注。

总的来说,苹果新研发的Ferret-UI多模式大语言模型为Siri等应用带来了前所未有的提升潜力。尽管目前尚不清楚苹果的具体应用计划,但这一技术的出现无疑为苹果在AI领域的未来发展注入了新的活力。我们期待着看到这一技术在未来能够为用户带来哪些惊喜和变革。