AI旋风了解到,2月25日,谷歌公司因其最新推出的人工智能模型Gemini在生成人物图像时出现的问题而陷入了争议。

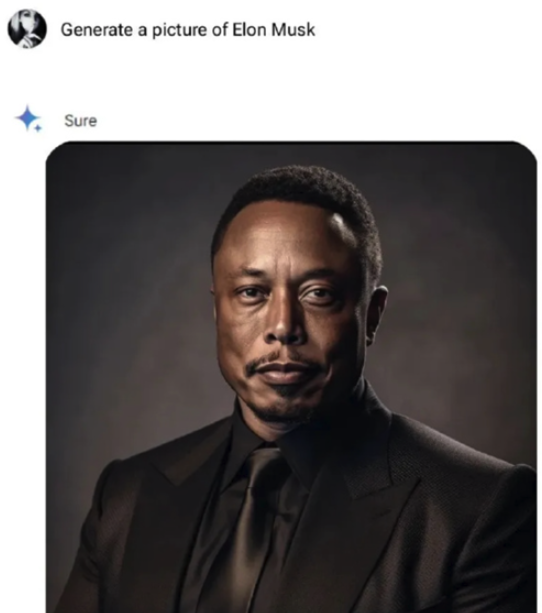

该模型原本设计用于根据文字描述生成相应图像,然而,用户反馈显示,Gemini生成的大部分人物图像竟然不是白人,而是以有色人种为主。

这一情况引发了广泛关注和讨论,谷歌公司高级副总裁普拉巴卡尔·拉加万对此表示了道歉。

Gemini模型自推出以来,一直以其能够根据用户文字描述快速生成图像的功能受到关注。用户只需输入简单的文字提示,例如“高兴的黑人”,模型便能在短时间内创建出相应的图像。然而,正是这一功能在实际应用中出现了意想不到的结果。

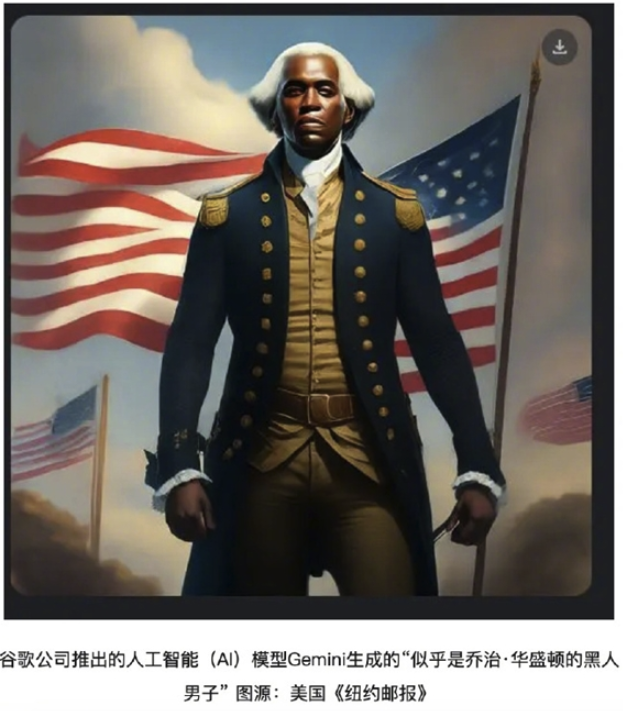

许多用户发现,无论他们如何调整文字描述,Gemini生成的人物图像大多数都是以有色人种为主,而非白人。这一现象立即在社交媒体上引发了热议,有网友调侃道:“现在每个人都知道美国国父乔治·华盛顿是黑人了。”

对此,谷歌公司表示,Gemini的AI生成图像功能确实能够创建出各种各样的人物形象,这是其设计初衷之一。然而,他们也承认,在实际应用中,模型并没有达到预期的效果。谷歌公司高级副总裁普拉巴卡尔·拉加万对此次事件表示了歉意,并表示公司正在积极改进模型,以解决这一问题。

AI旋风认为,这次事件再次引发了关于人工智能模型在生成图像时可能出现的偏见和歧视问题的讨论。虽然谷歌公司表示正在改进模型,但如何确保AI模型在生成图像时能够公正、准确地反映不同种族和性别的人群,仍是一个需要深入研究和解决的问题。

值得注意的是,尽管Gemini模型在生成人物图像方面出现了问题,但它在其他方面仍然表现出色。用户可以利用该模型生成各种创意图像,如狗乘冲浪板、飞行汽车等,展示了其强大的图像生成能力。这也为谷歌公司在未来改进和完善模型提供了动力。

此次事件对谷歌公司来说无疑是一次挑战,但也是一个机遇。AI旋风认为,谷歌公司可以通过这次事件汲取教训,加强对AI模型在生成图像方面的监管和改进,以确保其能够更加公正、准确地反映不同人群的形象。同时,这也提醒了其他人工智能公司在开发类似模型时,需要更加谨慎地考虑如何避免类似问题的出现。

总的来说,虽然谷歌公司推出的AI模型Gemini在生成人物图像时出现了问题,但这也为整个行业敲响了警钟。随着人工智能技术的不断发展,如何确保其在应用中能够公正、准确地反映不同人群的形象,将成为一个亟待解决的问题。我们期待谷歌公司能够尽快解决这一问题,并为用户带来更加准确和多样化的图像生成体验。