AI旋风了解到,英伟达公司近日发布了一款名为“Chat with RTX”的全新应用程序,这款应用程序专为Windows PC用户设计,由TensorRT-LLM提供技术支持。

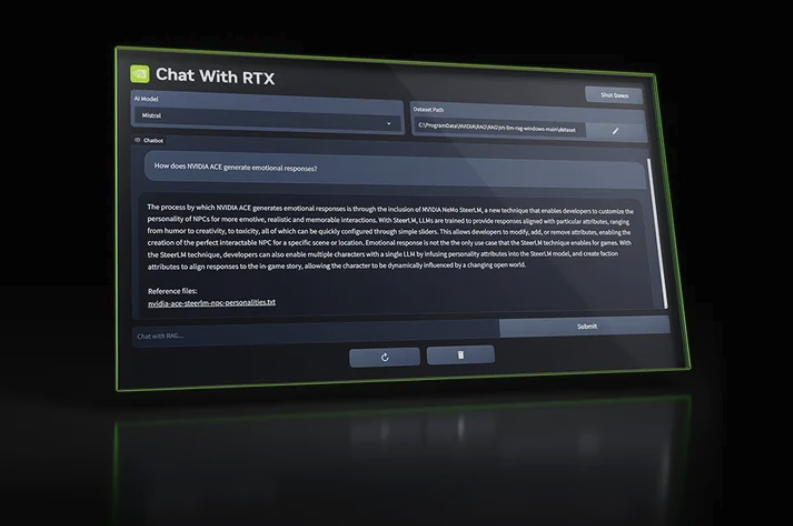

作为一款AI聊天机器人,Chat with RTX凭借其独特的本地化特性和强大的技术支持,为用户带来了前所未有的交互体验。

据英伟达官方介绍,Chat with RTX被设计为一个完全本地化的系统,用户无需上网即可轻松使用。这一特性使得它在当前的网络环境下具有极高的便利性和实用性。

值得一提的是,所有配备至少8 GB显存的GeForce RTX 30和40 GPU的设备都支持这款应用程序,这意味着绝大多数高端PC用户都能享受到这一全新技术带来的福利。

在功能方面,Chat with RTX展现出了极高的灵活性和兼容性。它支持多种文件格式,包括文本、PDF、DOC/DOCX和XML。用户只需将应用程序指向包含文件的文件夹,它便能在短短几秒内将这些文件加载到库中,为用户提供了极为便捷的AI文档处理方式。

‘此外,Chat with RTX还允许用户提供YouTube播放列表的URL,应用程序将自动加载播放列表中视频的转录,使用户能够轻松查询视频内容,大大提高了工作效率。

从使用方式来看,Chat with RTX与广受欢迎的ChatGPT有着异曲同工之妙。用户可以通过不同的查询方式,与Chat With RTX进行互动。然而,值得一提的是,Chat With RTX生成的结果将完全基于特定数据集,这使得它在生成摘要、快速搜索文档等操作中表现得尤为出色。

值得一提的是,拥有支持TensorRT-LLM的RTX GPU意味着用户将能够在本地使用所有数据和项目,而不是将它们保存在云中。这一特性不仅为用户节省了大量时间,还提供了更为精确的结果。

此外,英伟达表示,TensorRT-LLM v0.6.0将性能提升5倍,并计划于本月晚些时候推出。未来,这一技术还将支持其他LLM,如Mistral 7B和Nemotron 3 8B,为用户带来更为丰富和多样的应用场景。

AI旋风认为,英伟达发布的“Chat with RTX”应用程序无疑为聊天机器人领域注入了新的活力。凭借其独特的本地化特性和强大的技术支持,Chat with RTX有望为用户带来更为便捷、高效和精确的交互体验。同时,随着TensorRT-LLM技术的不断升级和完善,我们有理由相信这一应用程序将在未来为用户带来更多惊喜和可能性。